الذكاء الاصطناعي في مجال الأمن السيبراني لا تقدر بثمن ، لأن هذه التكنولوجيا ستغير وجه المشهد الأمني في العقد المقبل. من ناحية ، تمنحك القدرة على أن تكون استباقيا وتستجيب بسرعة للتهديدات والهجمات الرقمية. ومع ذلك ، يمكن لمجرمي الإنترنت أيضا الوصول إلى هذه التكنولوجيا ، مما يسهل الانخراط في الأنشطة الضارة.

مع تطور هذه التكنولوجيا الهامة وتحسينها ، حان الوقت لإلقاء نظرة فاحصة. دعونا نفهم كيف تستخدم صناعة الأمن السيبراني هذه التقنية ، وما هي الأدوات المتاحة ، والمشاكل التي تطرحها.

جدول المحتويات

الذكاء الاصطناعي تهديدات الأمن السيبراني: 3 طرق يستفيد بها مجرمو الإنترنت من هذه التكنولوجيا

يمتلك مجرمو الإنترنت أيضا أيديهم على أدوات تعمل بالذكاء الاصطناعي (الذكاء الاصطناعي). هذا يمنحهم الوسائل لتنفيذ هجمات معقدة. فيما يلي ثلاثة الذكاء الاصطناعي تهديدات للأمن السيبراني يجب أن تعرفها.

1. تقنيات الهندسة الاجتماعية المتطورة

البشر هم دائما الحلقة الأضعف ، حتى لو كان لديك بنية تحتية حديثة لاكتشاف الهجمات الإلكترونية ومنعها. الهندسة الاجتماعية هي طريقة لاستخراج المعلومات الخاصة أو الوصول إلى الأنظمة والشبكات الآمنة. يستخدم مجرمو الإنترنت هذه التقنية لأنها فعالة بشكل استثنائي في مساعدتهم على تحقيق أهدافهم الشائنة.

يمكن للجهات الفاعلة السيئة إنشاء محتوى بسرعة باستخدام أدوات الذكاء الاصطناعي المختلفة. سيستخدمون بعد ذلك مثل هذا المحتوى لخداع الأشخاص للقيام بأشياء لا يفعلونها عادة.

على سبيل المثال ، يتظاهر مجرمو الإنترنت بأنهم من دائرة الإيرادات الداخلية (IRS). يمكنهم إنشاء محتوى يبدو شرعيا ورسميا باستخدام أدوات الذكاء الاصطناعي ، يطلب منك دفع مستحقاتك. قد يتصل بك الممثلون السيئون ويستخدمون صوتا مزيفا لإقناعك بأنك تتعامل بالفعل مع مصلحة الضرائب.

2. التزييف العميق عالي الجودة

يستخدم مجرمو الإنترنت الذكاء الاصطناعي التزييف العميق لخلق العديد من المشكلات المتعلقة بالأمن السيبراني. يمكن للجهات الفاعلة السيئة استخدام هذه التكنولوجيا لانتحال شخصية الأفراد البارزين. توزيع هذا النوع من المحتوى بسيط. أيضا ، يمكن للناس بسهولة افتراض أن هذه الصور ومقاطع الفيديو المزيفة حقيقية.

عادة ، يستخدم مجرمو الإنترنت هذه التكنولوجيا جنبا إلى جنب مع تقنيات الهندسة الاجتماعية لضمان فعالية هجماتهم.

هناك أيضا أمثلة من العالم الحقيقي لجهات فاعلة سيئة تستخدم تقنية التزييف العميق لخداع الشركات والأفراد. على سبيل المثال ، حولت شركة متعددة الجنسيات 25 مليون دولار إلى مجرمي الإنترنت بعد أن قاموا بالتزييف العميق للمدير المالي للمؤسسة. أنشأ هؤلاء الأفراد شخصيات مزيفة لأشخاص حقيقيين واستخدموا هذه التكنولوجيا في مكالمة فيديو.

وبالمثل ، كان تايلور سويفت جزءا من هجوم التزييف العميق على X. أنشأ الممثلون السيئون صورا مزيفة لنجم البوب ووزعوها على X ، الآن Twitter.

3. أدوات الذكاء الاصطناعي المستهدفة بتقنيات تسمم البيانات

يعتمد الذكاء الاصطناعي بشكل كبير على البيانات التي تقدمها لتحقيق نتائج دقيقة. إذا كانت هناك أخطاء في مجموعات البيانات هذه ، تصبح المخرجات غير دقيقة. يمكن لمجرمي الإنترنت تسميم البيانات التي تستخدمها هذه الأدوات لإنشاء أبواب خلفية.

على سبيل المثال ، تستخدم الشركة أداة الذكاء الاصطناعي لتقليل رسائل البريد الإلكتروني التي تحتوي على بريد عشوائي ومحتوى ضار. يمكن للقراصنة تسميم البيانات التي تستخدمها هذه المنظمة لتدريب هذه الأداة وتحسينها. بمرور الوقت ، يمكنهم الحصول على هذه الأداة للسماح برسائل البريد الإلكتروني ذات الروابط الضارة. يتيح ذلك للجهات الفاعلة السيئة الحصول على وصول غير مصرح به عندما يزور موظف غير مطمئن عنوان URL في البريد الإلكتروني.

يمكن للقراصنة أيضا تسميم مجموعات البيانات للتأكد من أن الأدوات الذكاء الاصطناعي تمنحهم معلومات خاصة مع مطالبات محددة.

كيف يمكن استخدام الذكاء الاصطناعي التوليدية في الأمن السيبراني: 3 حالات استخدام لهذه التكنولوجيا

يمكن الذكاء الاصطناعي التوليدية صياغة المحتوى ، مثل مقاطع الفيديو والصوت والصور والنصوص. على سبيل المثال ، يعد ChatGPT من Open الذكاء الاصطناعي و Gemini من Google أمثلة واقعية على هذه التكنولوجيا. كيف يمكن استخدام الذكاء الاصطناعي التوليدية في الأمن السيبراني؟

فيما يلي ثلاث طرق يستخدم بها الخبراء والمؤسسات هذه التكنولوجيا للحفاظ على أمانهم.

1. تحليل واكتشاف سلوك المستخدم المشبوه

باستخدام تقنيات التعلم الآلي، يمكنك إنشاء ملفات تعريف سلوك لموظفي مؤسستك. إنها الأساس لكيفية تصرف الأشخاص عند استخدام أجهزة شركتك.

باستخدام هذه النماذج ، يمكن للأدوات الذكاء الاصطناعي البحث عن القيم المتطرفة ولفت انتباه محللي الأمن في الشركة. يمكن لهؤلاء المحترفين بعد ذلك التفكير في كيفية منع حدوث هذه الأنواع من الهجمات الإلكترونية في المستقبل.

وبالمثل ، لنفترض أن لديك أداة لاكتشاف برامج الروبوت على موقع الويب الخاص بك. الروبوتات لها تأثير سلبي على تجربة المستخدم (UX) ، لأنها تميل إلى إرباك الموارد المتاحة. قد يلاحظ الأشخاص أن موقع الويب الخاص بك يتم تحميله ببطء ، أو أن الخدمات الأخرى لا تعمل.

من خلال دراسة وتحليل نشاط الروبوت ، يمكن لهذه الأدوات اكتشاف سلوك مماثل وحظر هؤلاء الزوار على الفور.

2. تقليل الوقت اللازم للرد على الهجمات الإلكترونية

تحدث الهجمات الإلكترونية بسرعة ، وتستغرق فرق الأمن السيبراني وقتا للاستجابة. كلما كان رد فعل هذه الفرق أسرع ، كان ذلك أفضل للمؤسسة. يمكن أن تساعد أدوات الأمان الذكاء الاصطناعي في تحسين وقت الاستجابة.

بالنسبة للمبتدئين ، عندما تعاني مؤسسة ما من هجوم ، يمكن لهذه التقنية جمع وتصنيف البيانات ذات الصلة. يمكنه أيضا إنشاء تقارير وتبسيط المعلومات. يمكن لفرق الأمن السيبراني مراجعة هذه التقارير وفهم مسار العمل التالي.

يمكن للشركات استخدام هذه الأدوات لدراسة أنماط الهجمات السابقة وكيفية استجابتها لهذه التهديدات. بمرور الوقت ، يمكن أن تقترح هذه التقنية أفضل مسار للعمل إذا كانت المنظمة تعاني من هجوم إلكتروني مماثل.

3. التعرف على أسباب التهديدات المحتملة

تستخدم معظم الهجمات الإلكترونية التي تواجهها أكواد وأطر عمل قديمة المصدر كأسس لها. ومع ذلك ، يجد البشر صعوبة في اكتشاف تهديدات مماثلة والاستجابة في الوقت المناسب. هذا هو المكان الذي يمكن الذكاء الاصطناعي أن تساعد فيه في تحسين الأمن السيبراني.

يتعلم من مجموعات بيانات الهجوم المختلفة ويقارنها بالتهديدات الجديدة للبحث عن ما هو مشترك بين الاثنين. هذا يجعل التعرف على التهديدات المحتملة أسهل واتخاذ تدابير السلامة اللازمة لمنع مثل هذه الهجمات.

3 عيوب الذكاء الاصطناعي في الأمن السيبراني

على الرغم من أن الذكاء الاصطناعي يظهر الكثير من الوعود ، إلا أن له نصيبه العادل من الجوانب السلبية. فيما يلي ثلاثة عيوب الذكاء الاصطناعي في الأمن السيبراني.

1. إنه عرضة لمجموعات البيانات السيئة

مجموعات البيانات هي شريان الحياة للتقنيات الذكاء الاصطناعي ، لأنها تعتمد على هذه المعلومات لاتخاذ قرارات موثوقة. كما أوضحنا سابقا ، تكمن المشكلة في أن الجهات الفاعلة السيئة يمكنها التلاعب بهذه البيانات. أيضا ، يمكن أن توفر أدوات الذكاء الاصطناعي نتائج غير موثوقة إذا قمت بإطعامهم مجموعات بيانات خاطئة.

هذا يقدم التحيزات ويؤدي أيضا إلى أن تصبح الإيجابيات الكاذبة هي القاعدة. على سبيل المثال ، يمكن لأداة تصفية البريد الإلكتروني التي تعمل بنظام الذكاء الاصطناعي ضمان عدم رؤية الأشخاص للبريد العشوائي في لوحات المعلومات الخاصة بهم. ومع ذلك ، نظرا للبيانات السيئة ، فإنه يزيل أي بريد إلكتروني يحتوي على رابط ، لأنه يفترض أن هذه الرسالة غير مرغوب فيها. أو يمكن أن يسيء تصنيف الموظفين على أنهم ممثلون سيئون ، ويمنعهم من الوصول إلى أنظمتهم ، ويضيع وقتهم.

2. يزيد من معدل تطور وسرعة الهجمات الإلكترونية

يتعين على المتخصصين في الأمن السيبراني بالفعل التعامل مع التهديدات التي تستمر في التطور وتصبح متطورة. مع التكنولوجيا الذكاء الاصطناعي ، يمتلك مجرمو الإنترنت الأدوات اللازمة لزيادة معدل التطور هذا. يتعلمون تقنيات جديدة ، وينشرون هجمات معقدة ، ويستهدفون منظمات مختلفة بسرعة.

الذكاء الاصطناعي يجعل من الصعب التكيف مع الطبيعة المتغيرة باستمرار للهجمات الإلكترونية. تندرج الإجراءات الأمنية القديمة في الفئة القديمة ، لذلك يجب على المطورين تطوير حلول جديدة بانتظام.

3. لا يزال يتطلب ذكاء بشري

على الرغم من أن هذه التكنولوجيا قوية بشكل لا يصدق ، إلا أنها لا تزال بحاجة إلى مدخلات البشر لتكون فعالة حقا. بالنسبة للمبتدئين ، يتعين على الناس تزويد هذه الأدوات بمجموعات البيانات اللازمة. أيضا ، يجب على البشر الوصول إلى الجزء السفلي من أي مشكلة يواجهونها أثناء استخدام هذه التكنولوجيا.

إذا أصبح الناس راضين عن أنفسهم ، فقد تصبح هذه الأدوات غير فعالة بمرور الوقت. فبادئ ذي بدء، تقدم مجموعات البيانات السيئة تحيزات في المخرجات، مما يجعل النتائج غير دقيقة. وبالمثل ، إذا لم يكتشف البشر الأخطاء ويصححونها ، فستستمر التكنولوجيا في ارتكاب نفس الأخطاء.

2 أدوات الأمن السيبراني القائمة على الذكاء الاصطناعي التي يجب عليك استخدامها اليوم

يعد دمج أدوات الأمن السيبراني القائمة على الذكاء الاصطناعي في البنية التحتية الحالية أمرا ضروريا للحفاظ على أمانك. فيما يلي قائمة بأداتين فعالتين يجب عليك استخدامهما.

1. فيكترا الذكاء الاصطناعي

Vectra الذكاء الاصطناعي هي أداة موثوقة للأمن السيبراني تستخدم الذكاء الاصطناعي. من السهل دمج هذه التقنية مع إطار العمل الحالي الخاص بك. تقوم هذه الأداة بتعيين درجات لمتجهات التهديدات المختلفة لمساعدتك في تحديد أولوياتها وإصلاحها بسرعة.

تمتلك الشركة 35 براءة اختراع للكشف عن التهديدات وهي واثقة مما يمكنها فعله لأمن شبكتك. كما أنه يساعد فريقك على التعامل مع الهجمات في الوقت الفعلي ويقلل من عدد التنبيهات غير ذات الصلة.

2. دارك تريس

Darktrace هي أداة للأمن السيبراني قائمة على الذكاء الاصطناعي وهي نشطة دائما وتبحث عن الهجمات. يمكنك استخدام هذا لمراقبة شبكتك ورسائل البريد الإلكتروني والتطبيقات والخدمات السحابية والمزيد. يستمر في التعلم والتحسين بعد نشره مع البنية التحتية الخاصة بك.

إنه يمنح فرق الأمن الخاصة بك مساحة كافية للتنفس ، حيث يمكنه اكتشاف التهديدات المختلفة ومكافحتها. تتعرف هذه الأداة على ما هو طبيعي في شركتك وتضع علامة على الأنشطة غير العادية.

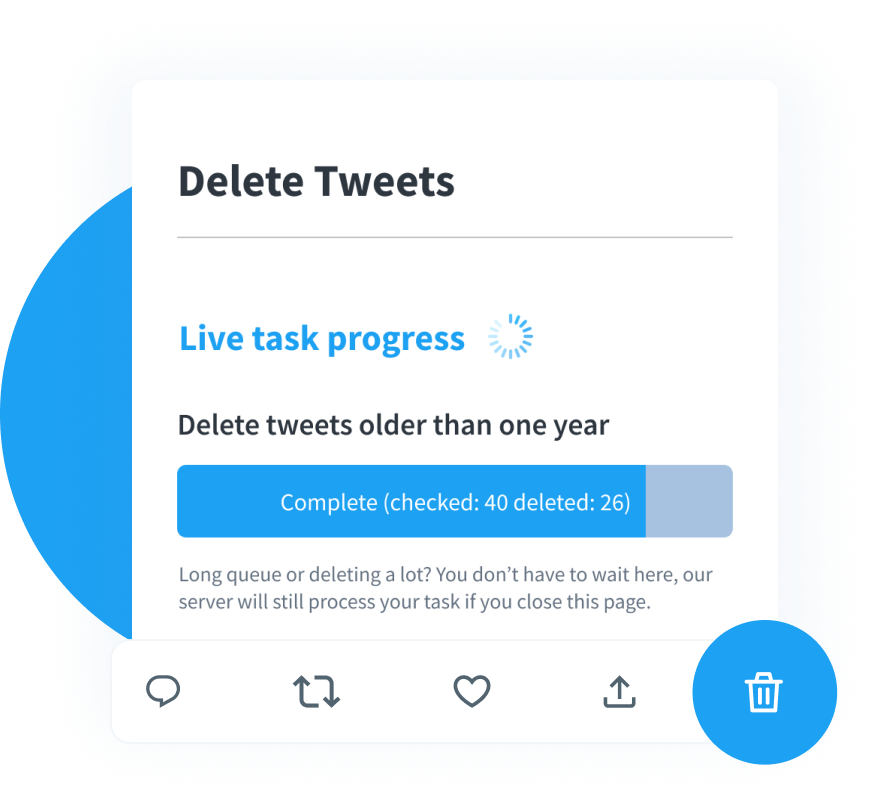

يمنع TweetDelete أخطاء الذكاء الاصطناعي التوليدية من الإضرار بمصداقيتك

يتمتع الذكاء الاصطناعي التوليدي في الأمن السيبراني بإمكانات هائلة ، والتي ستصبح واضحة مع تحسن هذه التكنولوجيا. تعمل هذه الأدوات على زيادة عملية اتخاذ القرار لفريق الأمان الخاص بك مع تقليل وقتهم في القيام بالأنشطة الدنيوية.

على الرغم من أن الذكاء الاصطناعي التوليدية أمر لا يصدق ، إلا أنه يعاني من الكثير من المشاكل في حالته الحالية. تميل مولدات التغريدات الذكاء الاصطناعي هذه إلى الهلوسة ، أي توليد معلومات مضللة. المشكلة هي أن هذه الخدمات يمكن أن تجعل حتى المعلومات الخاطئة تبدو مقنعة.

يمكن أن يؤدي نشر تغريدات بمثل هذا المحتوى إلى الإضرار بمصداقيتك ، خاصة عند محاولة وضع نفسك كخبير في الأمن السيبراني. مع TweetDelete ، لن تكون هذه مشكلة حقا ، حيث لديك الأدوات اللازمة لإزالة آلاف المنشورات بسرعة.

كيف تفعل هذا؟ أولا ، تحتاج إلى تشغيل الفلتر المخصص للعثور على جميع المنشورات ذات المحتوى الذي تم إنشاؤه الذكاء الاصطناعي. الخطوة التالية هي استخدام الأداة المساعدة للحذف الجماعي للتغريدات لإزالتها من صفحة ملفك الشخصي على X.

ماذا لو لم يكن لديك الوقت لإزالة المشاركات حول الذكاء الاصطناعي في مجال الأمن السيبراني؟ في هذه الحالة ، تكون مهمة الحذف التلقائي هي كل ما ستحتاج إليه. سيطلب منك كلمات رئيسية محددة ونطاقا زمنيا للعثور على التغريدات ذات المحتوى الذكاء الاصطناعي.

يمكنك أيضا حذف كل مشاركة في ملفك الشخصي فقط لتكون في الجانب الأكثر أمانا باستخدام هذه الأداة.

امنع أخطاء الذكاء الاصطناعي التوليدية من التأثير على مصداقيتك على X ، Twitter سابقا ، باستخدام TweetDelete اليوم!