人工知能(AI)が実用化されて数十年。しかし、その能力の驚異的な進歩の速さによって、この町では人工知能が話題になっている。特にソーシャルメディアでは、コンテンツ制作者がテキストや画像ベースのコンテンツを作成するためにAIを使用しているため、AIを実際に目にすることができる。

この技術を使って人間が何ができるかを考えると、AIの倫理的な使用について議論することが不可欠になっている。

目次

AIの倫理的利用:この技術に対する信頼を生み出す枠組み

企業や業界は、AIを日常活動に組み込むためのソリューションを見つけようとしている。その結果、倫理的な境界を設ける必要性が高まっている。これは、この高度な自動化技術を開発する企業が安全かつ倫理的に行うことを保証するものである。

AIにおける倫理とは、こうした高度な自律システムの悪用を防ぐための適切なガイドラインを設定することである。また、ユーザーのプライバシーにも焦点を当て、偏見による個人の差別を防止する。その目的は、道徳的原則を設定し、様々な活動を許容可能かつ正当な使用の下に世界的に分類することである。

政府の規制当局はすでに、こうしたシステムの倫理的使用に関する枠組みやガイドラインの作成に取り組んでいる。しかし、AIモデルが急速に進化する中、法律がその変化に対応するのは難しい。さらに、これらのツールの公正な開発を保証するためのリソースがない場合もある。

AIツールを開発し、誰もが利用できるようにするのは民間企業だからだ。彼らは行動規範と倫理に関する基準を設定しなければならない。正しく実行されれば、将来この技術に取り組もうとする企業は、従うべき強固なガイドラインを持つことになる。

AIシステムは、学習するデータと同程度の性能を持つ。不正確さや偏りは、長期的には重大な悪影響を及ぼす可能性がある。これらのモデルは、不利な個人に対して不利になったり、不正確な発言をしたりする可能性がある。これらのツールの保守を担当するエンジニアでさえ、こうした誤りを修正するのは困難だと感じるだろう。

例えば、ツイッターの画像切り抜きアルゴリズムは、肌の色が白い人を優遇していた。その結果、肌の色が濃い人の顔が切り取られてしまった。倫理的なガイドラインを設定することで、今後このような事態が起こりにくくなります。

4 AIにおける倫理への挑戦

これらは強力で複雑な技術ではあるが、それでも完璧ではない。これらのツールの作成者は、以下の4つのポイントで強調されているように、倫理に関する多くの現実的な疑問に答えなければならない:

- AIが使用するデータセットが公正であることを保証すること:組織は、性別、民族性、人種に基づく様々なバイアスを含むデータセットでAIツールを訓練すべきではない。

- 個人や悪質業者がAIモデルを悪用するのを防ぐ:悪用を防ぐためのガードレールはいくつか存在するが、個人は回避策を見つけ続けている。企業は、安全性を向上させ、セキュリティリスクを可能な限り低減するために、より優れたソリューションを開発しなければならない。

- 問題が発生した場合の報告:AIモデルに問題が発生した場合、研究者は問題の背後にある理由を報告し、明らかにする必要がある。これは、データセットやアルゴリズムがAIベースの判断に与える影響を説明することを意味する。問題の根本を追跡することは、問題を解決するために不可欠である。

- 個人のプライバシーを守る:AIモデルは、効果的かつ効率的なツールとなるよう、一般に公開されているデータを基に学習する。しかし、この恩恵はデータを共有するという代償を伴うことを、人々は理解する必要がある。これらのモデルは必要なものだけを収集し、この情報を責任を持って使用しなければならない。また、収集したファイルを必要としなくなったら、データを削除すべきである。

ツイッターのディープフェイク欺瞞的マルチメディアに対するXのスタンス

ディープフェイクとは、基本的に本物ではないコンピューター生成の動画や画像のことである。通常は、既存のマルチメディアを使用し、他のコンテンツと重ね合わせる。

例えば、TikTokを使っている人なら、アメリカの俳優トム・クルーズ(@TomCruise)のディープなフェイクに遭遇したことがあるかもしれない。顔入れ替えフィルターに似ているが、このテクニックは非常に複雑で説得力がある。

いわば、Photoshopをリアルタイムで使うようなものだ。複数の画像に対して機械学習アルゴリズムをトレーニングし、高品質のなりすましを作成する。この技術の問題点は、悪質な業者が偽のコンテンツを作成するために利用できることだ。

ディープフェイクを使えば、たとえ現実にやっていないことでも、人に何かをさせたり言わせたりすることができる。だからこそ、人々はこの技術に倫理的な懸念を抱いているのだ。

ツイッターのディープフェイクは、同プラットフォームの合成・加工メディアポリシーに反する。このルールによると、このプラットフォームは、操作されたメディアや合成メディアを共有することを許可していません。

現在Xとなったツイッターは、ディープフェイクに出くわしたときどうするのだろうか?プラットフォームは、改ざんされたメディアについてユーザーに知らせるために、そのようなコンテンツにラベルを付けるかもしれない。Xは、投稿の可視性を下げることで、人々がそのようなコンテンツを見つけにくくすることができる。彼らはエンゲージメントをオフにする権限を持っている。また、投稿を他の人と共有する際に警告メッセージが表示されることもある。

ディープフェイクがコミュニティや個人に害を及ぼす場合、Xは投稿者に投稿を取り下げるよう求める。投稿者がディープフェイクコンテンツをシェアし続ける場合、ソーシャルネットワークはそのアカウントを発見しにくくする。また、その人のプロフィールをロックしたり、ルール違反で利用停止にすることもできる。

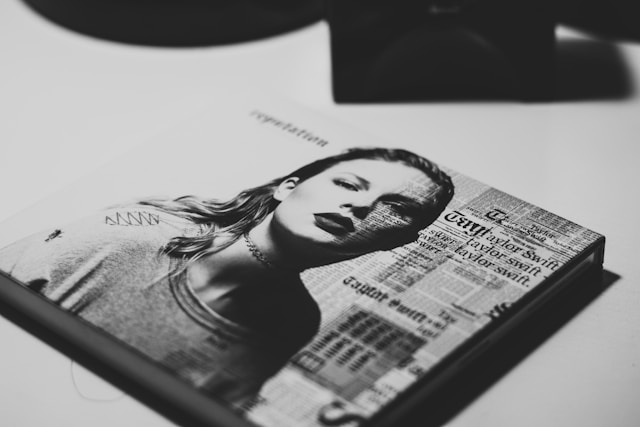

テイラー・スウィフトとツイッタースウィフト・ディープ・フェイク・スキャンダルの裏話

テイラー・スウィフトとツイッターの関係が気になるところだろう。このニュースは数日前から話題となり、このミュージシャンもソーシャルメディア・プラットフォームのトレンド入りした。

2024年1月25日、X上で、認証されたユーザーによるテイラー・スウィフトの偽画像が氾濫した。この投稿は4,500万ビュー、26万の「いいね!」、2万4,000のリポストを記録した。Xは元の投稿を削除するのに17~19時間を要した。

この間、何人かのユーザーがこのツイートをリポストし、偽の画像を野火のように広めた。Xは以下の理由でこの投稿を削除することができた:

- この画像は、同プラットフォームの合成・加工メディアポリシーに違反していた。

- この写真はXの非合意ヌード(NCN)ポリシーに反する。

ツイッターはその後、検索エンジンでテイラー・スウィフト(@taylorswift13)を検索できないようにし、元の発信者のアカウントを停止した。これは、ディープフェイクコンテンツの潜在的なリスクと、それを阻止することがいかに難しいかを示している。

記事で強調されているように、これは人々がAIを悪意のある理由で利用する数多くの方法のひとつである。

ツイッターのAIガイドライン:オールインワンガイド

AIは、特にツイッターの世界で実際に応用されている。例えば、BufferやHootsuiteのようないくつかのツールは、AIツイートジェネレーターを提供している。

同様に、OpenAIのChatGPTやGoogleのGeminiを使って投稿を生成することもできる。しかし、このようなツールを使う前に、いくつかのルールを決めておくとよいだろう。以下のAIガイドラインは、あなたが責任を持って安全にこのテクノロジーを使用することを保証します。

1.Xの目標を概説する

TwitterアカウントにAIツールを活用することで、何を達成したいのかを常に把握しておく方がよい。そうすることで、要件を満たすサービスを見つけやすくなります。

2.AIが生成したコンテンツを扱う専門家を配置する

プロンプトの質は、さまざまなAI生成ツールからの結果の良し悪しを決定する。プロンプトとは、これらのサービスに入力として提供するものである。あなたの合図が一般的なものであれば、AIツールは退屈なコンテンツを生成する。結果の質を高めるには、具体的で詳細なプロンプトを使用する必要がある。

もしこれがあなたの好みに合わないのであれば、専門家にこの作業を依頼するのがベストだ。専門家は、AIツールが生成するコンテンツを人間の判断で作成し、レビューする。また、これらのサービスに関するあらゆる問題のトラブルシューティングも彼らに頼ることができる。

3.AIの利用について明確にする

ターゲットとする視聴者に正直であることは、あなたのアカウントを信頼できるものにする。AIの使用について透明性を保つことは、多くの人々がこのテクノロジーについて何を考えているのかわからないため、難しいことである。

新しいツールを受け入れる者もいれば、可能性に慎重な者、あるいは恐怖を抱く者もいる。

プロフィールにAIを使用することについて透明性を保つことは、長期的にはあなたの助けになります。投稿のアイデアを生み出すためにAIジェネレーターを使う予定ですか?ビジュアルコンテンツ戦略でAIが生成した画像を使いたいのですか?それとも、あなたのブランドに関連するハッシュタグを生成するために使うつもりですか?

これは必須ではないが、AIツールの使用についてターゲットオーディエンスに知らせることはできる。このテクノロジーに対するフォロワーの不安を和らげるために、さらに一歩踏み込んで、何を期待すべきかを説明しよう。

ターゲットとする読者は、あなたの透明性への努力を高く評価するだろう。

4.AIが生成したコンテンツを公開する前にダブルチェックする

AIツールは素晴らしいが、完璧とは言い難い。良いニュースは、人々があなたのコンテンツを理解しやすくなることだ。

一方、AIは時に誤った情報を生成する。さらに、『Science Advances』の研究論文によれば、AIが生成したコンテンツとユーザーが書いたコンテンツを区別するのは難しい。

例えば、グーグルのジェミニでは、生成された回答をダブルチェックすることができる。緑色でハイライトされたコンテンツは、その発言にソースがあることを示している。また、そのトピックに関するより多くの情報を得るための関連検索も表示される。

そこで、AIコンテンツ・エキスパートの出番となる。生成されたコンテンツに誤りがないかを確認します。また、念のため盗用がないかチェックするのもよい。

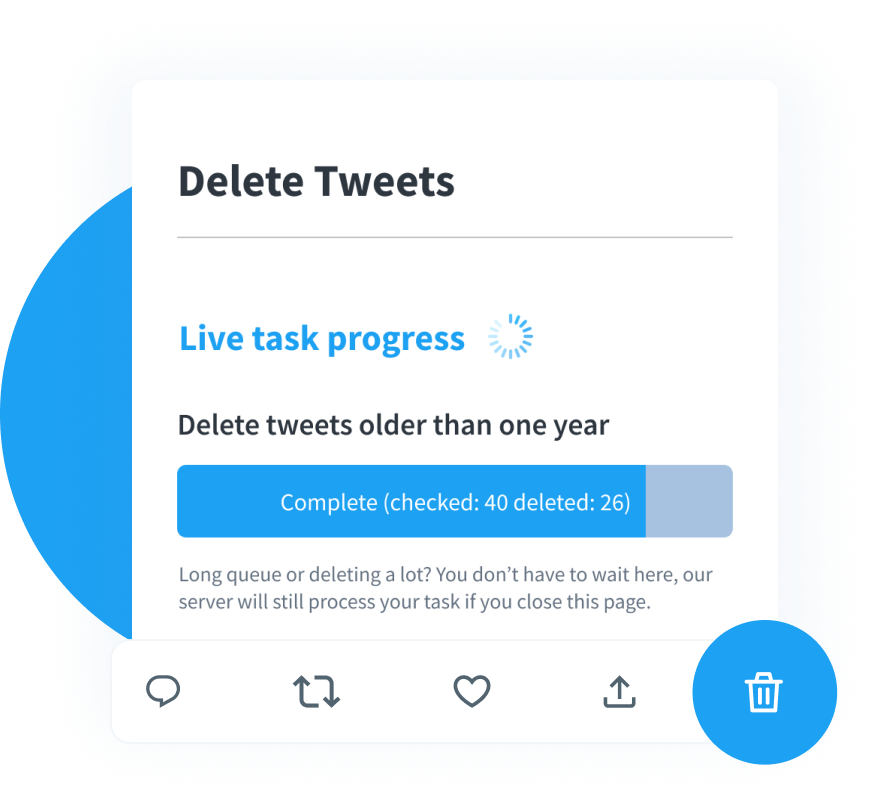

TweetDeleteで何百ものAI生成ツイートを削除する

AIによるコンテンツ生成ツールの使用を検討している場合は、倫理的かつ責任を持って使用するようにしてください。これらのツールから生成されたすべての文章を常に検証し、公開する前にコンテンツガイドラインに適合していることを確認してください。

AIが生成したコンテンツにおいて、正当な情報と誤った情報を区別するのは難しい。AIが使う言語パターンや文体には説得力がある。例えば、公開された投稿を見直しても、何も違和感がない。

この方法で何百ものツイートを公開し、後になってその情報が不正確であることがわかったらどうだろう?

TweetDeleteは、あなたのミスがあなたの信頼性に影響を与えるのを防ぐのに役立ちます。カスタムフィルターでAIが作成した投稿をすべてリストアップできます。ツイートを一括削除するツールを使って、プロフィールページからこれらのツイートを素早く削除しましょう。

自動削除タスクを実行して、削除後の処理を自動化するオプションもある。生成されたツイートに含まれるキーワードやハッシュタグを提供すると効果的です。

AIツールの倫理的な使用は、この強力なテクノロジーがポジティブな影響を与えることを確実にする最善の方法である。これらのモデルは、許容可能なリスクでコンテンツ作成プロセスをスピードアップすることで、時間の節約に役立つ。

あなたのプロフィールをスキャンして不正確な情報を含むツイートを探し、TweetDeleteを使ってこれらの投稿を即座に削除しましょう!