A inteligência artificial (IA) está a ser utilizada há várias décadas. No entanto, tornou-se o tema de conversa da cidade devido à incrível taxa de avanço das suas capacidades. É possível vê-la em ação, especialmente nas redes sociais, uma vez que os criadores de conteúdos a utilizam para criar conteúdos baseados em texto e imagens.

Tornou-se essencial discutir a utilização ética da IA, tendo em conta o que as pessoas podem fazer com esta tecnologia.

Índice

Utilização ética da IA: o quadro para criar confiança nesta tecnologia

As empresas e as indústrias estão a tentar encontrar soluções para integrar a IA nas suas actividades diárias. Consequentemente, há uma maior necessidade de estabelecer limites éticos. Isto garante que as empresas que desenvolvem esta tecnologia de automatização avançada o fazem de forma segura e ética.

A ética na IA consiste em definir orientações adequadas para evitar a utilização indevida destes sistemas autónomos avançados. Também se centra na privacidade do utilizador e impede a discriminação de indivíduos devido a preconceitos. O objetivo é definir princípios morais e classificar globalmente várias actividades em termos de utilização aceitável e legítima.

Os reguladores governamentais já estão a trabalhar na criação de quadros e orientações para a utilização ética destes sistemas. No entanto, pode ser difícil para as leis acompanharem as mudanças, uma vez que os modelos de IA evoluem rapidamente. Além disso, podem não ter os recursos necessários para garantir o desenvolvimento justo destas ferramentas.

O ónus recai sobre as empresas privadas, uma vez que são elas que desenvolvem e colocam as ferramentas de IA à disposição de todos. Têm de estabelecer normas relativas ao código de conduta e à ética. Se o fizerem corretamente, as empresas que queiram trabalhar com esta tecnologia no futuro terão orientações sólidas a seguir.

Os sistemas de IA são tão bons quanto os dados com que aprendem. As imprecisões e os preconceitos podem ter impactos negativos significativos a longo prazo. Estes modelos podem tornar-se desfavoráveis em relação a indivíduos sub-representados ou produzir declarações inexactas. Mesmo os engenheiros responsáveis pela manutenção destas ferramentas terão dificuldade em corrigir estes erros.

Por exemplo, o algoritmo de corte de imagens do Twitter favoreceu as pessoas com peles mais claras. Como resultado, cortou os rostos de pessoas com tons de pele mais escuros. A definição de directrizes éticas pode garantir que estas situações sejam menos prováveis de acontecer no futuro.

4 Desafios da ética na IA

Embora se trate de tecnologias poderosas e complexas, ainda não são perfeitas. Os criadores destas ferramentas têm de responder a muitas questões do mundo real sobre ética, tal como destacado nos quatro pontos abaixo:

- Garantir que os conjuntos de dados que a IA utiliza são justos: As organizações não devem treinar ferramentas de IA com conjuntos de dados que contenham vários preconceitos com base no género, etnia e raça.

- Impedir que os indivíduos e os maus actores utilizem indevidamente os modelos de IA: Embora existam várias barreiras de proteção para evitar a utilização indevida, as pessoas continuam a encontrar soluções alternativas. As empresas devem desenvolver melhores soluções para melhorar a segurança e reduzir ao máximo os riscos de segurança.

- Comunicar se e quando as coisas correrem mal: Se houver um problema com o modelo de IA, os investigadores têm de comunicar e clarificar a razão por detrás do problema. Isto significa explicar o impacto dos conjuntos de dados e dos algoritmos nas decisões baseadas na IA. A identificação da origem do problema é essencial para o resolver.

- Manter a privacidade dos indivíduos: Os modelos de IA são treinados com base em dados publicamente disponíveis para serem ferramentas eficazes e eficientes. No entanto, as pessoas têm de compreender que este benefício tem o custo da partilha dos seus dados. Estes modelos devem recolher apenas o necessário e utilizar esta informação de forma responsável. Além disso, devem apagar os dados quando já não precisarem dos ficheiros recolhidos.

Twitter Deep Fakes: A posição da X sobre multimédia enganosa

Os deep fakes são essencialmente vídeos e imagens gerados por computador que não são reais. Normalmente, envolvem a utilização de multimédia existente e a sua sobreposição com outros conteúdos.

Por exemplo, se utiliza o TikTok, pode ter encontrado falsificações profundas de Tom Cruise (@TomCruise), o ator americano. Embora semelhante ao filtro de troca de rosto, esta técnica é altamente complexa e convincente.

De certa forma, pode pensar-se nesta técnica como a utilização do Photoshop em tempo real. Envolve o treino de algoritmos de aprendizagem automática em várias imagens para produzir imitações de alta qualidade. O problema com esta tecnologia é que os maus actores podem utilizá-la para criar conteúdos falsos.

Com os deep fakes, é possível fazer com que as pessoas façam ou digam qualquer coisa, mesmo que não o tenham feito na vida real. É por isso que as pessoas têm preocupações éticas relativamente a esta tecnologia.

As falsificações profundas do Twitter vão contra a política de meios sintéticos e manipulados da plataforma. De acordo com estas regras, a plataforma não permite a partilha de meios de comunicação manipulados ou sintéticos se estes induzirem as pessoas em erro.

O que é que o Twitter, agora X, faz quando se depara com falsificações profundas? A plataforma pode rotular esses conteúdos para informar os utilizadores sobre os meios de comunicação alterados. X pode tornar mais difícil para as pessoas encontrarem esses conteúdos, diminuindo a visibilidade das publicações. Têm autoridade para desativar o envolvimento. Poderá também ver uma mensagem de aviso quando partilhar a publicação com outras pessoas.

Se a falsificação profunda prejudicar uma comunidade ou uma pessoa, o X pede ao autor que retire a publicação. Se o editor continuar a partilhar conteúdos profundamente falsos, a rede social dificulta a descoberta da sua conta. Pode também bloquear o perfil da pessoa ou suspendê-la por violar as suas regras.

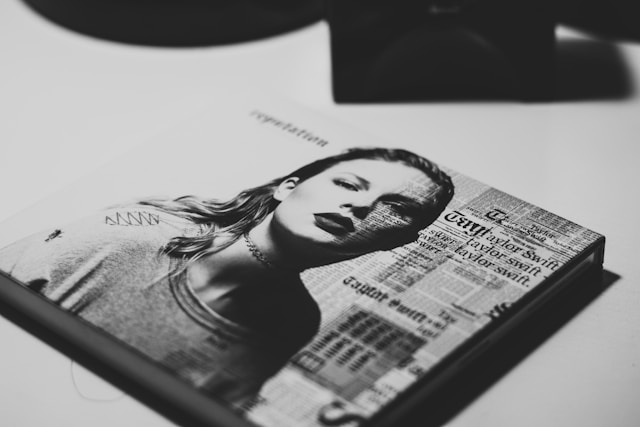

Taylor Swift e o Twitter: A história por detrás do escândalo do Swift Deep Fake

Deve estar a perguntar-se o que se passa com Taylor Swift e o Twitter. Durante vários dias, o assunto esteve presente nas notícias e o músico também foi tendência na plataforma de redes sociais.

Em 25 de janeiro de 2024, houve uma inundação de imagens falsas de Taylor Swift no X de um utilizador verificado. A publicação recebeu mais de 45 milhões de visualizações, 260.000 gostos e 24.000 repostagens. O X demorou 17 a 19 horas a retirar a publicação original.

Durante este período, vários utilizadores repostaram este tweet e espalharam as imagens falsas como um incêndio. X conseguiu retirar a publicação pelas seguintes razões:

- A imagem violava a política de meios sintéticos e manipulados da plataforma.

- A fotografia viola a política de nudez não consensual (NCN) do X.

O Twitter impediu então que as pessoas procurassem Taylor Swift (@taylorswift13) no seu motor de busca e suspendeu a conta do editor original. Isto mostra os riscos potenciais de conteúdos falsos profundos e como é difícil impedi-los.

Tal como salientado no artigo, esta é uma das muitas formas de utilizar a IA por razões nefastas.

Directrizes de IA para o Twitter: O guia completo

A IA tem aplicações reais, especialmente no Twitterverse. Por exemplo, várias ferramentas como o Buffer e o Hootsuite fornecem geradores de tweets com IA.

Da mesma forma, pode utilizar o ChatGPT da OpenAI ou o Gemini da Google para gerar mensagens. No entanto, antes de utilizar essas ferramentas, é bom ter algumas regras em vigor. As seguintes directrizes de IA podem garantir que utiliza esta tecnologia de forma responsável e segura.

1. Trace os seus objectivos para X

É sempre melhor saber o que pretende alcançar utilizando ferramentas de IA para a sua conta do Twitter. Desta forma, é mais fácil encontrar o serviço que satisfaz as suas necessidades.

2. Atribuir um perito para lidar com os conteúdos gerados pela IA

A qualidade dos prompts determina o calibre dos resultados de várias ferramentas de geração de IA. Uma sugestão é o que o utilizador fornece como entrada para estes serviços. As ferramentas de IA gerarão conteúdos aborrecidos se as suas sugestões forem genéricas. É necessário ser específico e utilizar sugestões pormenorizadas para melhorar a qualidade dos resultados.

Se isto não for do seu agrado, é melhor pedir a um especialista que se encarregue desta tarefa. O perito produzirá e analisará o conteúdo gerado por estas ferramentas de IA utilizando a avaliação humana. Também pode contar com eles para resolver quaisquer problemas com estes serviços.

3. Ser claro sobre a utilização da IA

Ser honesto com o seu público-alvo tornará a sua conta credível e digna de confiança. Ser transparente sobre a utilização da IA é um desafio, uma vez que muitas pessoas não sabem o que pensar sobre esta tecnologia.

Alguns abraçam as novas ferramentas, enquanto outros são cautelosos ou têm medo do que é possível.

Ser transparente quanto à utilização de IA no seu perfil pode ajudá-lo a longo prazo. Está a planear utilizar geradores de IA para criar ideias para publicações? Pretende utilizar imagens geradas por IA na sua estratégia de conteúdo visual? Ou está a planear utilizá-la para gerar hashtags relevantes para a sua marca?

Embora não seja necessário, pode informar o seu público-alvo sobre a utilização de ferramentas de IA. Vá mais longe e explique o que esperar para aliviar os receios dos seus seguidores relativamente a esta tecnologia.

O seu público-alvo apreciará o seu esforço para ser transparente.

4. Verificar duas vezes os conteúdos gerados por IA antes de os publicar

Embora as ferramentas de IA sejam incríveis, estão longe de ser perfeitas. A boa notícia é que tornam mais fácil para as pessoas compreenderem o seu conteúdo.

Por outro lado, a IA gera por vezes informações incorrectas. Além disso, de acordo com um artigo de investigação publicado na revista Science Advances, é difícil distinguir entre conteúdo gerado por IA e conteúdo escrito pelo utilizador.

Por exemplo, o Gemini do Google permite-lhe verificar novamente a resposta que gera. Qualquer conteúdo destacado a verde indica que existe uma fonte para a afirmação. Também mostra pesquisas relacionadas para obter mais informações sobre o tópico.

É aqui que o seu especialista em conteúdos de IA entra em ação. Ele irá rever o conteúdo gerado para garantir que não contém erros. Além disso, é bom verificar se há plágio, só para ficar do lado mais seguro.

Remover centenas de tweets gerados por IA com o TweetDelete

Se está a considerar utilizar ferramentas de geração de conteúdos com tecnologia de IA, certifique-se de que as utiliza de forma ética e responsável. Verifique sempre todas as declarações geradas por estas ferramentas e certifique-se de que cumprem as suas directrizes de conteúdo antes de as publicar.

É difícil distinguir entre informação legítima e desinformação em conteúdos gerados por IA. Os padrões de linguagem e os estilos de escrita que utiliza podem ser convincentes. Por exemplo, quando analisou as mensagens publicadas, não parecia haver nada fora do sítio.

E se publicasse centenas de tweets desta forma, apenas para descobrir mais tarde que a informação é incorrecta?

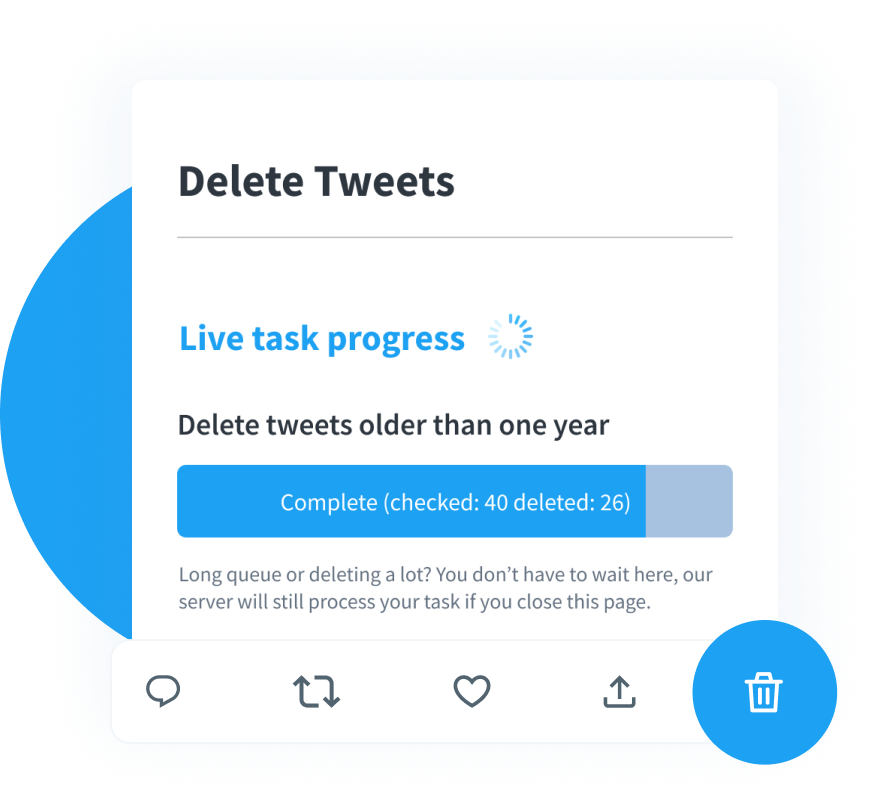

O TweetDelete pode ajudar a evitar que seus erros afetem sua credibilidade. É possível listar todas as publicações geradas por IA com o filtro personalizado. Remova rapidamente esses tweets da página do seu perfil com a ferramenta de exclusão em massa detweets.

Existe a opção de automatizar o processo pós-exclusão executando a tarefa de exclusão automática. Funciona melhor se fornecer as palavras-chave e hashtags que os tweets gerados contêm.

A utilização ética das ferramentas de IA é a melhor forma de garantir que esta poderosa tecnologia tem impactos positivos. Estes modelos podem ajudar a poupar tempo, acelerando o processo de criação de conteúdos com um risco aceitável.

Procure no seu perfil tweets com informações incorrectas e elimine imediatamente essas publicações com o TweetDelete!