L'intelligence artificielle (IA) est utilisée depuis plusieurs décennies. Cependant, elle est devenue le sujet de conversation de la ville en raison de l'incroyable taux de progression de ses capacités. Vous pouvez la voir à l'œuvre, en particulier sur les médias sociaux, où les créateurs de contenu l'utilisent pour élaborer des textes et des images.

Il est devenu essentiel de discuter de l'utilisation éthique de l'IA, compte tenu de ce que les gens peuvent faire avec cette technologie.

Table des matières

Utilisation éthique de l'IA : le cadre pour créer la confiance dans cette technologie

Les entreprises et les industries tentent de trouver des solutions pour intégrer l'IA dans vos activités quotidiennes. Par conséquent, il est de plus en plus nécessaire de mettre en place des limites éthiques. Cela permet de s'assurer que les entreprises qui développent cette technologie d'automatisation avancée le font en toute sécurité et dans le respect de l'éthique.

L'éthique de l'IA consiste à établir des lignes directrices adéquates pour prévenir l'utilisation abusive de ces systèmes autonomes avancés. Elle se concentre également sur la protection de la vie privée des utilisateurs et empêche la discrimination des individus en raison de préjugés. L'objectif est de fixer des principes moraux et de classer diverses activités dans le cadre d'une utilisation acceptable et légitime.

Les régulateurs gouvernementaux travaillent déjà à la création de cadres et de lignes directrices pour l'utilisation éthique de ces systèmes. Toutefois, il peut s'avérer difficile pour les lois de suivre les changements, car les modèles d'IA évoluent rapidement. En outre, elles ne disposent pas toujours des ressources nécessaires pour garantir un développement équitable de ces outils.

La responsabilité incombe aux entreprises privées, car ce sont elles qui développent et mettent les outils d'IA à la disposition de tous. Elles doivent établir des normes concernant le code de conduite et l'éthique. Si elles le font correctement, les entreprises qui souhaitent travailler sur cette technologie à l'avenir disposeront de lignes directrices solides à suivre.

La qualité des systèmes d'IA dépend des données à partir desquelles ils apprennent. Les inexactitudes et les préjugés peuvent avoir des conséquences négatives importantes à long terme. Ces modèles peuvent devenir défavorables aux personnes sous-représentées ou produire des déclarations inexactes. Même les ingénieurs chargés de la maintenance de ces outils auront du mal à corriger ces erreurs.

Par exemple, l'algorithme de recadrage des images de Twitter favorise les personnes à la peau claire. Par conséquent, il a masqué les visages des personnes à la peau plus foncée. La mise en place de lignes directrices éthiques peut permettre de réduire la probabilité que de telles situations se reproduisent à l'avenir.

4 Les défis de l'éthique dans l'IA

Bien qu'il s'agisse de technologies puissantes et complexes, elles ne sont pas encore parfaites. Les créateurs de ces outils doivent répondre à de nombreuses questions concrètes en matière d'éthique, comme le soulignent les quatre points ci-dessous :

- Veiller à ce que les ensembles de données utilisés par l'IA soient équitables: Les organisations ne devraient pas former les outils d'IA avec des ensembles de données qui contiennent divers préjugés fondés sur le sexe, l'origine ethnique et la race.

- Empêcher les individus et les mauvais acteurs d'utiliser à mauvais escient les modèles d'IA: Bien qu'il existe plusieurs garde-fous pour empêcher les abus, les individus continuent de trouver des solutions de contournement. Les entreprises doivent développer de meilleures solutions pour améliorer la sécurité et réduire autant que possible les risques de sécurité.

- Signaler si et quand les choses tournent mal: en cas de problème avec le modèle d'IA, les chercheurs doivent signaler et clarifier la raison du problème. Cela signifie expliquer l'impact des ensembles de données et des algorithmes sur les décisions basées sur l'IA. Il est essentiel de remonter à la source du problème pour le résoudre.

- Préserver la vie privée des personnes: Les modèles d'IA s'appuient sur des données publiques pour devenir des outils efficaces et efficients. Toutefois, les gens doivent comprendre que cet avantage a pour contrepartie le partage de leurs données. Ces modèles ne doivent collecter que ce qui est nécessaire et utiliser ces informations de manière responsable. Ils doivent également supprimer les données lorsqu'ils n'ont plus besoin des fichiers collectés.

Twitter Deep Fakes : La position de X sur les multimédias trompeurs

Les deep fakes sont essentiellement des vidéos et des images générées par ordinateur qui ne sont pas réelles. Ils consistent généralement à utiliser des supports multimédias existants et à les superposer à d'autres contenus.

Par exemple, si vous utilisez TikTok, vous avez peut-être rencontré des imitations profondes de Tom Cruise (@TomCruise), l'acteur américain. Bien que similaire au filtre d'échange de visage, cette technique est très complexe et convaincante.

D'une certaine manière, vous pouvez considérer cette technique comme l'utilisation de Photoshop en temps réel. Il s'agit d'entraîner des algorithmes d'apprentissage automatique sur plusieurs images afin de produire des imitations de haute qualité. Le problème de cette technologie est que de mauvais acteurs peuvent l'utiliser pour créer du faux contenu.

Avec les deep fakes, on peut faire faire ou dire n'importe quoi aux gens, même s'ils ne l'ont pas fait dans la vraie vie. C'est pourquoi cette technologie suscite des préoccupations éthiques.

Les "deep fakes" de Twitter vont à l'encontre de la politique de la plateforme en matière de médias synthétiques et manipulés. Selon ces règles, la plateforme ne vous autorise pas à partager des médias manipulés ou synthétiques s'ils induisent les gens en erreur.

Que fait Twitter, devenu X, lorsqu'il est confronté à des "deep fakes" ? La plateforme peut étiqueter ces contenus pour informer les utilisateurs des médias modifiés. X peut faire en sorte qu'il soit plus difficile pour les utilisateurs de trouver ce type de contenu en réduisant la visibilité des messages. Ils ont le pouvoir de désactiver l'engagement. Un message d'avertissement peut également s'afficher lorsque vous partagez la publication avec d'autres personnes.

Si le deep fake risque de nuire à une communauté ou à une personne, X demande à l'auteur de retirer son message. Si l'éditeur continue à partager du contenu de deep fake, le réseau social rend plus difficile la découverte de son compte. Il peut également verrouiller le profil de la personne ou la suspendre pour avoir enfreint ses règles.

Taylor Swift et Twitter : L'histoire derrière le faux scandale de Swift Deep

Vous vous demandez peut-être ce qu'il en est de Taylor Swift et de Twitter. L'affaire a fait couler beaucoup d'encre pendant plusieurs jours, et la musicienne a également fait l'objet d'une tendance sur la plateforme de médias sociaux.

Le 25 janvier 2024, un utilisateur vérifié a publié une avalanche de fausses images de Taylor Swift sur le site X. Le message a reçu plus de 45 millions de vues, 260 000 likes et 24 000 rediffusions. Le message a été vu plus de 45 millions de fois, a reçu 260 000 likes et a été reposté 24 000 fois. Il a fallu 17 à 19 heures à X pour retirer le message original.

Pendant cette période, plusieurs utilisateurs ont reposté ce tweet et ont propagé les fausses images comme une traînée de poudre. X a pu retirer le message pour les raisons suivantes :

- L'image était contraire à la politique de la plateforme en matière de médias synthétiques et manipulés.

- La photo enfreint la politique de nudité non consensuelle (NCN) du X.

Twitter a alors empêché les internautes de rechercher Taylor Swift (@taylorswift13) dans son moteur de recherche et a suspendu le compte de l'éditeur original. Cela montre les risques potentiels des faux contenus profonds et la difficulté de les arrêter.

Comme le souligne l'article, il s'agit de l'une des nombreuses façons dont l'IA peut être utilisée à des fins malveillantes.

Lignes directrices en matière d'IA pour Twitter : Le guide tout-en-un

L'IA a des applications réelles, en particulier dans le monde de Twitter. Par exemple, plusieurs outils comme Buffer et Hootsuite proposent des générateurs de tweets à base d'IA.

De même, vous pouvez utiliser ChatGPT d'OpenAI ou Gemini de Google pour générer des messages. Toutefois, avant d'utiliser de tels outils, il est bon de mettre en place quelques règles. Les lignes directrices suivantes en matière d'IA vous permettront d'utiliser cette technologie de manière responsable et sûre.

1. Décrivez vos objectifs pour X

Il est toujours préférable de savoir ce que vous voulez obtenir en utilisant des outils d'IA pour votre compte Twitter. Il est ainsi plus facile de trouver le service qui répond à vos besoins.

2. Désigner un expert pour traiter le contenu généré par l'IA

La qualité des invites détermine le calibre des résultats des différents outils de génération d'IA. Une invite est ce que vous fournissez comme données à ces services. Les outils d'IA généreront un contenu ennuyeux si vos indications sont génériques. Vous devez être précis et utiliser des invites détaillées pour améliorer la qualité des résultats.

Si cela ne vous convient pas, il est préférable de confier cette tâche à un expert. Il produira et révisera le contenu généré par ces outils d'IA en s'appuyant sur le jugement humain. Vous pouvez également compter sur eux pour résoudre les éventuels problèmes liés à ces services.

3. Être clair sur l'utilisation de l'IA

En étant honnête avec votre public cible, vous rendrez votre compte crédible et digne de confiance. Faire preuve de transparence sur l'utilisation de l'IA est un défi, car de nombreuses personnes ne savent pas quoi penser de cette technologie.

Certains adoptent les nouveaux outils, tandis que d'autres sont prudents ou carrément effrayés par les possibilités qui s'offrent à eux.

Faire preuve de transparence quant à l'utilisation de l'IA sur votre profil peut vous aider à long terme. Prévoyez-vous d'utiliser des générateurs d'IA pour créer des idées de posts? Souhaitez-vous utiliser des images générées par l'IA dans votre stratégie de contenu visuel ? Ou prévoyez-vous de l'utiliser pour générer des hashtags pertinents pour votre marque ?

Bien que cela ne soit pas nécessaire, vous pouvez informer votre public cible sur l'utilisation des outils d'IA. Allez plus loin et expliquez ce à quoi vous pouvez vous attendre afin d'atténuer les craintes que suscite cette technologie parmi vos partisans.

Votre public cible appréciera votre effort de transparence.

4. Vérifier les contenus générés par l'IA avant de les publier

Bien que les outils d'IA soient incroyables, ils sont loin d'être parfaits. La bonne nouvelle, c'est qu'ils facilitent la compréhension de votre contenu.

D'autre part, l'IA génère parfois des informations erronées. En outre, selon un article de recherche paru dans Science Advances, il est difficile de faire la distinction entre les contenus générés par l'IA et ceux rédigés par les utilisateurs.

Par exemple, Gemini de Google vous permet de revérifier la réponse qu'il génère. Tout contenu surligné en vert indique qu'il existe une source pour l'affirmation. Il indique également les recherches connexes permettant d'obtenir davantage d'informations sur le sujet.

C'est là que votre expert en contenu IA entre en jeu. Il examinera le contenu généré pour s'assurer qu'il ne contient pas d'erreurs. Il convient également de vérifier qu'il n'y a pas de plagiat, pour plus de sécurité.

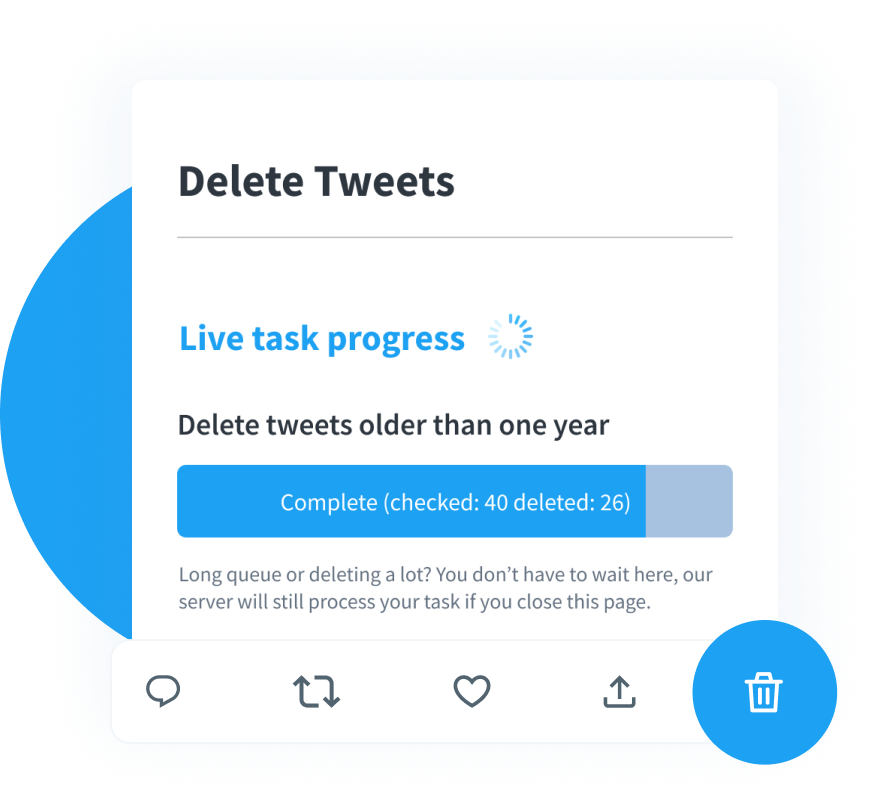

Supprimer des centaines de tweets générés par l'IA avec TweetDelete

Si vous envisagez d'utiliser des outils de génération de contenu basés sur l'IA, veillez à les utiliser de manière éthique et responsable. Vérifiez toujours toutes les déclarations générées par ces outils et assurez-vous qu'elles respectent vos directives en matière de contenu avant de les publier.

Il est difficile de faire la différence entre une information légitime et une information erronée dans un contenu généré par l'IA. Les modèles de langage et les styles d'écriture qu'elle utilise peuvent être convaincants. Par exemple, lorsque vous avez examiné les articles publiés, rien ne vous a semblé déplacé.

Que se passerait-il si vous publiiez des centaines de tweets de cette manière, pour découvrir par la suite que les informations sont inexactes ?

TweetDelete peut vous aider à éviter que vos erreurs n'affectent votre crédibilité. Vous pouvez répertorier tous les messages générés par l'IA à l'aide du filtre personnalisé. Supprimez rapidement ces tweets de votre page de profil grâce à l'outil de suppression massive detweets.

Il est possible d'automatiser le processus de post-suppression en exécutant la tâche de suppression automatique. Ce système fonctionne mieux lorsque vous fournissez les mots-clés et les hashtags que contiennent les tweets générés.

L'utilisation éthique des outils d'IA est le meilleur moyen de s'assurer que cette puissante technologie a des impacts positifs. Ces modèles peuvent aider à gagner du temps en accélérant le processus de création de contenu avec un risque acceptable.

Analysez votre profil pour détecter les tweets contenant des informations inexactes et supprimez-les immédiatement avec TweetDelete !